Persoonlijke informatie van Australische burgers in de staat Nieuw-Zuid-Wales is uitgelekt door ongeautoriseerd gebruik van ChatGPT. Dat meldde Tweakers vorige week. Dat riep vele vragen op: is dat wel een datalek, waar zijn de gegevens dan beland? En waarom is dit anders dan wanneer je iets naar een clouddienst uploadt?

Het persbericht van de betreffende overheidsdienst legt uit:

The breach occurred when a former contractor of the RA uploaded data containing personal information to an unsecured AI tool which was not authorised by the department. There is no evidence that any information has been made public (…).

Oké, dus een externe partij had een Excelbestand met persoonsgegevens geupload naar ChatGPT. Dat is (in ieder geval in Europa) een datalek in de zin van de AVG, omdat de data in strijd met de beveiligingsmaatregelen bij een ongeautoriseerde derde terecht kwam, namelijk OpenAI.

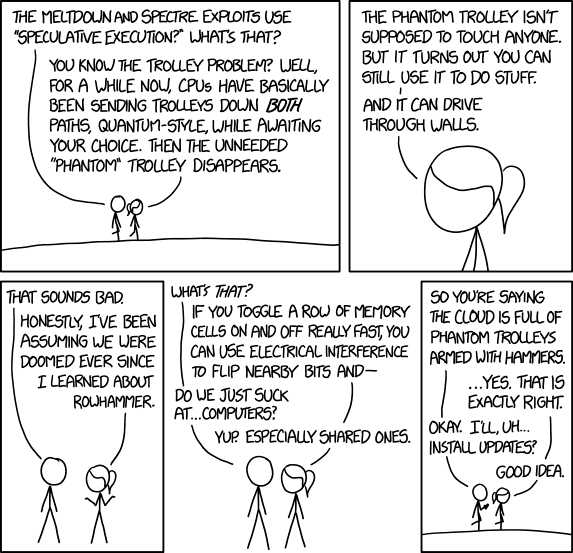

De achterliggende zorg is natuurlijk dat OpenAI haar taalmodel gaat bijtrainen op de geuploade data. Maar dat daardoor gegevens op straat komen te liggen is niet waarschijnlijk. ChatGPT is immers geen zoekmachine die zo’n Excelsheet lekker als bronbestand aanroept. Dat bijtrainen gaat over statistische patronen herkennen, niet over feitendatabanken bijwerken.

Om die reden zou ik wel durven twisten over of het bij zo’n upload “niet waarschijnlijk is dat de inbreuk in verband met persoonsgegevens een risico inhoudt voor de rechten en vrijheden van natuurlijke personen”, oftewel niet meldingsplichtig. Uit niets blijkt dat OpenAI meer doet dan bijtrainen met je data (en de Terms of Use beperken haar rechten ook tot dat).

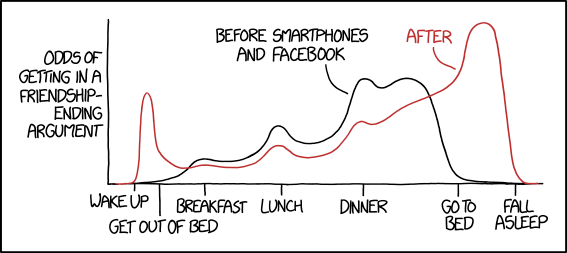

Hoe zit dat dan bij uploads naar andere clouddiensten? Ook daar begint het bij de vraag of die dienst geautoriseerd is. Zo niet, dan heb je volgens de definitie een datalek. Alleen zie je daar eerder clausules dat men de bestanden zelf mag herpubliceren, hergebruiken en delen met andere partijen. Dan komt de broninformatie dus elders terecht, buiten de macht en het zicht van betrokkenen.

Arnoud