De brief, die wordt gepubliceerd tijdens een conferentie over kunstmatige intelligentie in Melbourne, is onder meer ondertekend door Tesla-topman Elon Musk. Naast hem staan nog ruim honderd directeuren van prominente bedrijven als DeepMind, Clearpath Robotics en Blue Ocean Robotics onder de brief.

Volgens de ondertekenaars vormen autonome robots een gevaar voor burgers in oorlogsgebieden. “Dodelijke autonome wapens dreigen de derde revolutie in oorlogsvoering te worden”, staat in de brief. “Als ze eenmaal zijn ontwikkeld, zullen gewapende conflicten op een grotere schaal dan ooit tevoren kunnen worden uitgevochten, en veel sneller dan mensen kunnen bevatten.”

Doos van Pandora

In 2015 stuurde een groep experts ook al een brandbrief over het gevaar van killer robots. Dat leidde er een jaar later toe dat de VN een expertgroep in het leven riep om autonome wapensystemen te bespreken.

Die groep zou deze maand voor het eerst bijeenkomen, maar door geldgebrek zal dat nu op zijn vroegst in november gebeuren. De ondertekenaars van de brief roepen de VN op om deze nieuwe datum wel te halen.

“We hebben niet lang om hier iets aan te doen. Als deze doos van Pandora eenmaal open is, zal het moeilijk zijn hem weer te sluiten.”

Nederland

Een handvol ondertekenaars van de brief komt uit Nederland. Eén van hen is Koen Hindriks, directeur van de startup Interactive Robotics en universitair hoofddocent aan de TU Delft.

Volgens Hindriks moet worden voorkomen dat robots autonoom keuzes kunnen maken die over leven of dood gaan: “Zonder dat er een controle is vanuit de mens; dat wij niet meer kunnen ingrijpen.”

Het bedrijf van Hindriks maakt sociale robots, onder meer voor gebruik in het onderwijs. “Dus wij zijn er heel erg voor dat we robots maken die sociaal een positieve functie in de samenleving hebben.”

Musk

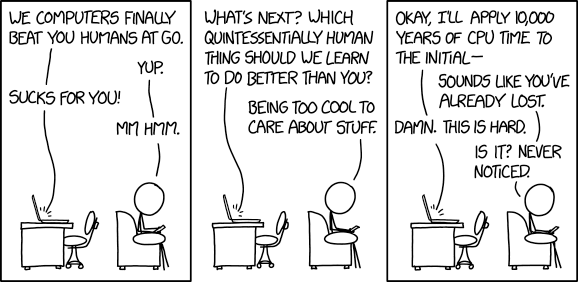

De robotexpert kan zich niet vinden in de uitspraken van Elon Musk, die regelmatig waarschuwt over de gevaren van kunstmatige intelligentie. Volgens Musk zullen superslimme robots mogelijk een bedreiging vormen voor de mensheid, en zorgt kunstmatige intelligentie voor “veel meer risico dan Noord-Korea”.

“Waar we nu zijn hoeven we ons absoluut nog geen zorgen te maken”, zegt Hindriks over zo’n ‘superintelligentie’. “Het grote probleem is juist het maken van vrij domme robots die kunnen schieten. Dat kunnen we al lang.”