Het Nederlands Forensisch Instituut (NFI) heeft een computermodel ontwikkeld waarmee het de politie kan helpen voorspellen welke berichten een serieuze bedreiging bevatten, meldt de overheidsinstelling woensdag.

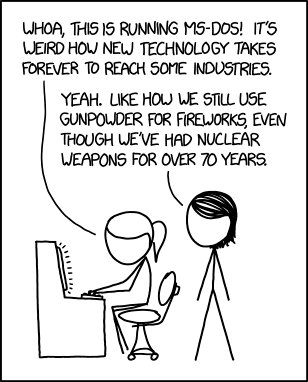

“Ik wil bloed zien”, of “Doe een kogel in zijn hoofd”. Het is slechts een greep uit de berichten die vorig jaar via EncroChat verstuurd werden door criminelen. In totaal 25 miljoen berichten werden onderschept door de politie, die de beveiligde chatdienst vorig jaar wist te kraken.

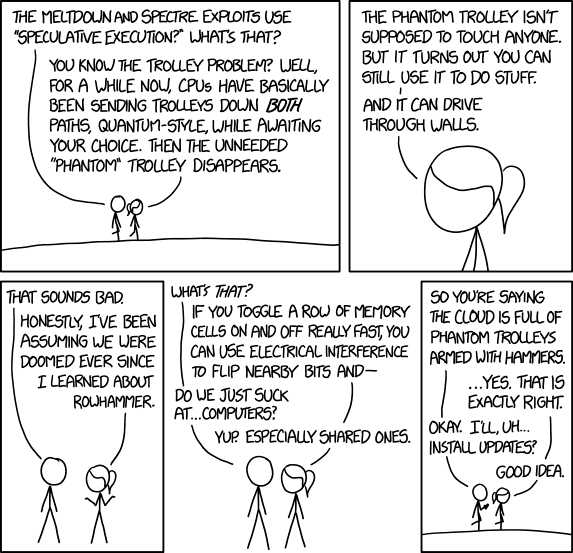

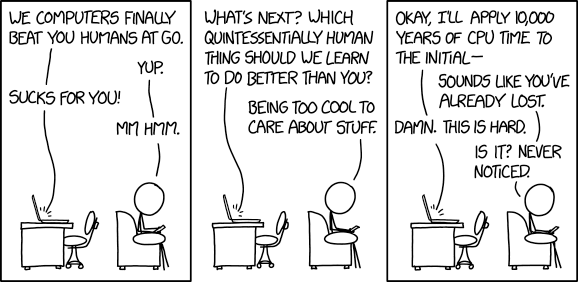

Deze miljoenen berichten handmatig doorzoeken, zou te veel werk zijn. Het team Forensische Big Data Analyse (FBDA) van het NFI besloot daarom een computermodel te ontwikkelen om levensbedreigende berichten uit gekraakte chatdiensten te filteren. Het model maakt gebruik van deep learning, een verzameling van technieken waarmee je computers taal kunt leren herkennen.

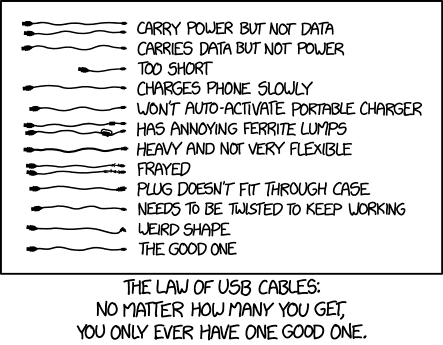

Medewerkers van het NFI hebben met politierechercheurs woordenlijsten met zogenoemde signaalwoorden gemaakt. Dat zijn woorden die criminelen kunnen gebruiken om te wensen of organiseren dat iemand mishandeld, ontvoerd of vermoord wordt. Ze gebruiken daarvoor bijvoorbeeld de woorden ‘dood’, ‘slapen’, ‘poppen’, ‘afknallen’ en ‘verdwijnen’.

Voor de woordenlijsten is ook historisch materiaal gebruikt. Europol, het samenwerkingsverband van de politiediensten van de Europese Unie, heeft geholpen bij het maken van een lijst met vergelijkbare woorden in het Frans en Engels.

Bedreigende of niet-bedreigende labels

De politierechercheurs gaven de gevonden resultaten vervolgens het label ‘bedreigend’ of het label ‘niet-bedreigend’ mee. Zo leerden de computers meer over de context van de berichten. Medewerkers van het NFI hebben zo tienduizenden bedreigende en niet-bedreigende zinnen ingevoerd om het model te trainen.

Volgens het instituut geeft het model geen 100 procent garantie. “De computer helpt de mens bij het zoeken, maar een algoritme kan dingen missen”, aldus het NFI.