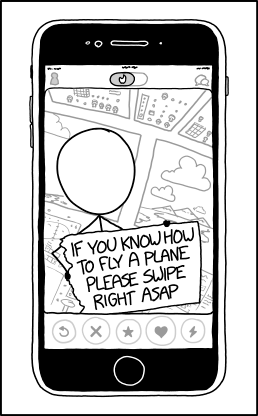

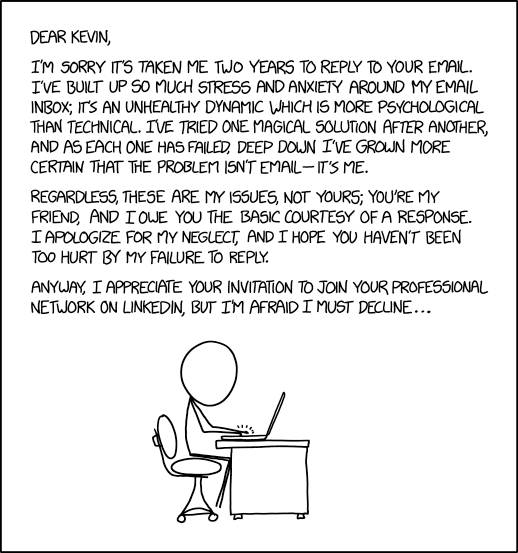

Diverse lezers tipten me dat auteur K.C. Krowne in diens boek een ChatGPT prompt had laten staan (afbeelding). “Zeker, hier is een herziene tekst waarin je hoofdpersoon meer relateerbaar wordt terwijl de tegenspeler net wat meer sexy neergezet wordt.” Onhandig, beschamend, zeker. Maar zo vroeg een lezer: is daar juridisch wat aan te doen? Ik verwacht een boek van een mens, en dan is het AI prut.

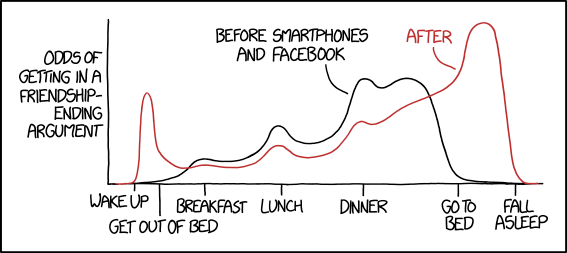

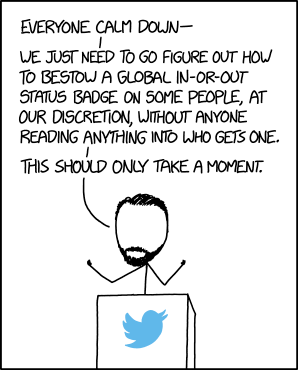

Al een jaar geleden gingen vele alarmbellen af dat met name de Amazon Kindle marketplace overspoeld wordt met goedkope snel uit AI getrokken boeken (ik weiger “geschreven” te gebruiken). Amazon heeft nu de regel dat je maar drie boeken per dag mag publiceren, en zelfs dat heeft beperkt effect.

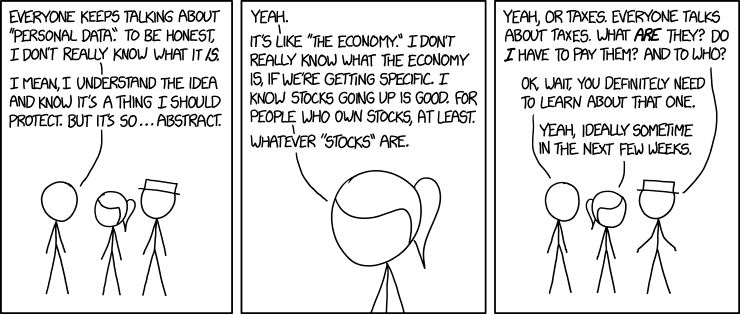

Echt leuke verhalen lijken het me niet, zeker op roman-lengte:

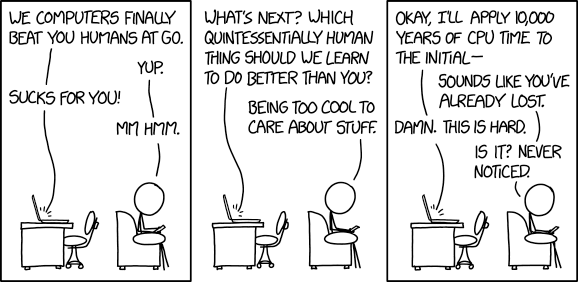

Most AI systems struggle with maintaining structure and continuity in extended texts. Also, most LLMs tend to produce average prose without expert input, a phenomenon known as “regression towards the mean.” This trait, he said, often leads to a dilution of the writer’s unique style and voice, resulting in writing that readers might find unremarkable, dull, or lacking inspiration.

Het achterliggende businessmodel is simpel. Die ebooks gaan voor 99 cent per stuk, in de hoop dat mensen denken “toch even proberen” en dan voor die ene euro niet gaan klagen als het tegenvalt. En omdat je inkoopsprijs nul is (goed, 20 euro per maand abonnement), is elke euro dan leuke winst.

Mag het? De AI Act staat je toe om te verzwijgen dat je AI hebt gebruikt als je de uitvoer een menselijke redactieslag hebt gegeven (art. 50 lid 4 AIA). Sowieso hoef je bij fictie tekst geen AI-melding te plaatsen van die wet.

Ik snap de insteek van de lezer wel, dat dit wel eens een misleidende handelspraktijk of oneerlijke reclame kan zijn. In reclame misleiden over

de identiteit, hoedanigheden, bekwaamheid of bevoegdheid en degene door wie, onder wiens leiding of toezicht of met wiens medewerking de goederen zijn of worden vervaardigd of aangeboden of de diensten worden verricht.

is onrechtmatig, net als meer algemeen het weglaten van essentiële informatie die de consument nodig heeft bij een koop (art. 6:194 BW). Hetzelfde geldt voor misleidende handelspraktijken, waar ook zaken staan als “procédé en datum van fabricage of verrichting” (art. 6:193c BW).

Het enige is natuurlijk – er is nog nooit een zaak geweest dat het misleidend is dat een boek door een machine is afgescheiden in plaats van door een mens geschreven. Dat was in het zakelijk verkeer nooit echt mogelijk.

Of nou ja, je hebt natuurlijk al heel lang de praktijk van het ghostwriten, een ander inhuren om jouw werk te schrijven. Of dat nou echt veel voorkomt bij fictiewerk is mij nooit duidelijk geworden. In de VS lijkt het wel legaal te zijn, omdat daar in 2003 is uitgemaakt dat een onjuiste auteursvermelding geen merkenrechtelijke “valse oorsprongvermelding” is.

Zeker bij het uitgeven van onbekende auteurs kun je je afvragen wat de relevantie voor de consument is dat sprake was van een ghostwriter. Of je nu van onbekende auteur Jan dan wel Yanick een boek koopt, je zult eerder afgaan op de flaptekst of de reputatie van de uitgever dan op de biografie. En als de kans op feitelijke misleiding afwezig is, dan kan geen sprake zijn van juridische misleiding.

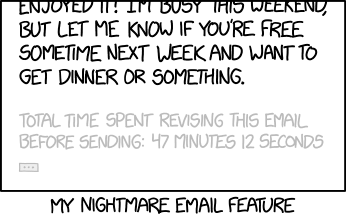

Bij AI prut ligt dat denk ik toch anders. Daar gaat het niet zozeer om welke naam er op staat, maar dat dit de belofte geeft dat er een mens aan gewerkt heeft. Dat staat voor enige kwaliteit en consistentie, en die belofte wordt dan geschonden door een pak papier waar ChatGPT uitvoer op staat.

Daar staat dan natuurlijk weer tegenover dat iedereen weet dat op de Kindle Marketplace mensen zelf mogen publiceren zonder screening, dus daar ga je sowieso al héél veel troep tegenkomen. Maakt het dan nog veel uit dat er AI troep tussen zit?

Arnoud