Rutte & de Jonge – White Christmas (ft. van Dissel, Gommers), Deepfake | Fake It or Leave It, 2021

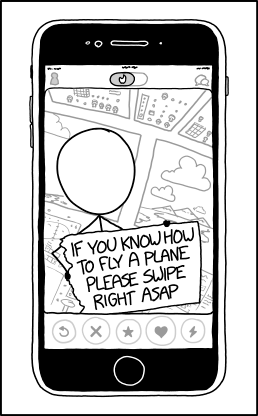

Een app waarmee je jezelf in het letterlijk gezicht aanmeet van je favoriete voetballer, niet bestaande figuren die ons het nieuws voorlezen of technologie waarmee je jezelf in een kerstfilm plaatst; deepfakes zorgen voor veel creativiteit. Maar wat als deze technologie ingezet wordt om politici woorden in de mond te leggen? Wanneer we Biden Baby Shark horen zingen, of Rutte een progressieve klimaatboodschap proclameert? Deepfakes zijn het volgende stadium op de trap van desinformatie en zorgen wereldwijd voor veel hoofdbrekers omtrent hoe ze te lijf te gaan.

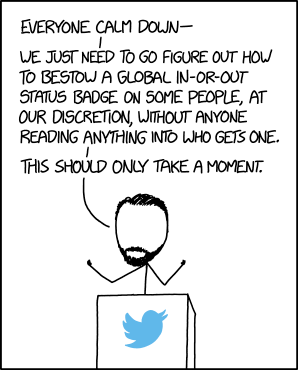

De meerderheid van de Tweede Kamer gaf vorige week te kennen dat ze bepaalde vormen van deepfakes bij wet wil verbieden. In het politieke debater hierover wordt vooral ingegaan op de handhavingsmogelijkheden van zo’n verbod. Hierbij wordt echter voorbijgegaan aan de fundamentelere vragen: moet je deepfakes wel verbieden?

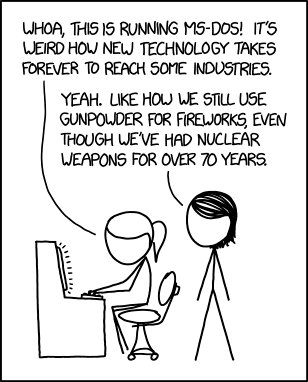

Een verbod van bepaalde vormen van technologie zal altijd achterhaald zijn.

Deepfakes stellen nieuwe vragen aan auteurschap en authenticiteit. Wie is er verantwoordelijk voor de productie, is dat de maker van de deepfake of het platform dat deze verspreid? En als je een hoofd van een ander op een willekeurig lichaam plaatst, kunnen we dan nog wel aanspraak maken op persoonsschending? Je bent het immers niet zelf meer. Bovendien is het de vraag of ingrijpen wel mag, gezien de wet op vrijheid van meningsuiting. Deze vragen zijn op zijn zachts gezegd ingewikkeld.

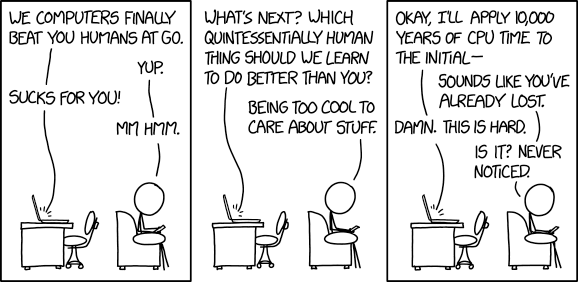

Een wet die deepfakes verbiedt suggereert bovendien dat het mogelijk zou zijn fake van echt te kunnen onderscheiden. Echter, mensen zijn op dit moment eigenlijk al niet meer in staat om dat te doen en ook detectietechnologie kan deepfakes nauwelijks bijbenen. We staan waar het gaat om validatie eigenlijk voortdurend 1-0 achter. Welk wetgevingsproduct er momenteel ook geïntroduceerd wordt: een verbod van bepaalde vormen van technologie zal altijd achterhaald zijn.

Bovendien zal detectietechnologie – hoe goed in staat ook om een oorspronkelijke van een gesynthetiseerd bron te onderscheiden – juist ook nieuwe, menselijke, ideeën als vreemd en fake kunnen aanmerken, omdat die niet herkend kunnen worden als authentiek op basis van eerdere bronnen. De Galileo Galilei’s van deze tijd zullen daardoor uit het systeem gefilterd worden. En dat is het laatste wat we moeten willen.

Hyperrealiteit

De focus zou veel meer moeten komen te liggen op het doorgronden van de sociaal-politieke aard van dit vraagstuk en het duiden van de technocalyptische samenleving waarin we nu eenmaal opereren. Deepfakes zijn een reflectie van onze hyperrealiteit; een tijdperk waarin we een nieuwe delicate dans ontwikkelen rondom echt, nep en alles daartussen. Dat vraagt om nieuwe vormen van duiding, contextualisering, validatie en weerbaarheid.

‘Fake’ niet per se ‘niet waar’

In plaats van de focus te leggen op verbieden of het ontwikkelen van nieuwe wetten, moet juist de aandacht naar nieuwe samenwerkingen tussen deepfake experts, journalisten, mensenrechten deskundigen, politici en het publiek om zo gezamenlijk te verkennen welke omgangsvormen we hierin willen ontwikkelen. De Amerikaanse denktank WITNESS bestaande uit zo’n gemengde groep experts, zet in op publieke dialogen waarbij beheerders van platforms, sociale mediasites en zoekmachines, in nauwe samenwerking met journalisten, mediaconsumenten en mensenrechtenexperts een gezamenlijk aanpak ontwerpen. Laten we kortom inzetten op het omarmen van de deepfake als mogelijkheid onszelf te scherpen in het duiden van onze hyperrealiteit. We zouden soms de deepfake juist moeten omarmen omdat het ons ook kan inspireren en ons op nieuwe ideeën kan brengen. Denk aan AI art- of tekst generatoren waarmee we op basis van steekwoorden prachtige afbeeldingen en verhalen kunnen laten maken, die onze fantasie en wetenschappelijke creativiteit weer aan het werk zetten.

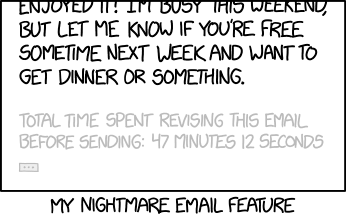

Daarnaast is ‘fake’ niet per se ‘niet waar’. Een student die een scriptie laat schrijven met behulp van ChatGPT levert wellicht geen onjuiste dingen in, of leert hierdoor misschien andere dingen vergeleken met het zelf de pen ter hand nemen. Waar een onderwijsinstelling zich hier op zou moeten richten is niet zozeer de vraag of de scriptie echt of nep is, maar of er nieuwe ideeën gegenereerd worden die het werkveld beter maken. Wanneer we aan de hand van die maatstaf goede criteria gebruiken, wordt de vraag rondom ‘fake’ veel minder relevant. De technologie is er, en zal blijven. We moeten beter leren omgaan met het onvermijdelijke door de juiste vragen en eisen te stellen ten aanzien van deze technologie.

Daniëlle Arets, lector Journalistiek en Verantwoorde Innovatie, Fontys Hogeschool

Leon Kester, senior research scientist gespecialiseerd in artificial intelligence safety & ethics, TNO