Er komt voorlopig geen kinderpornodetectie op iPhones, meldt Apple vrijdag aan onder meer CNBC. Het bedrijf kondigde vorige maand een scansysteem aan waarmee op iPhones en iPads de aanwezigheid van kinderporno kan worden gedetecteerd. Het bedrijf zegt nu meer tijd nodig te hebben om het systeem te verbeteren.

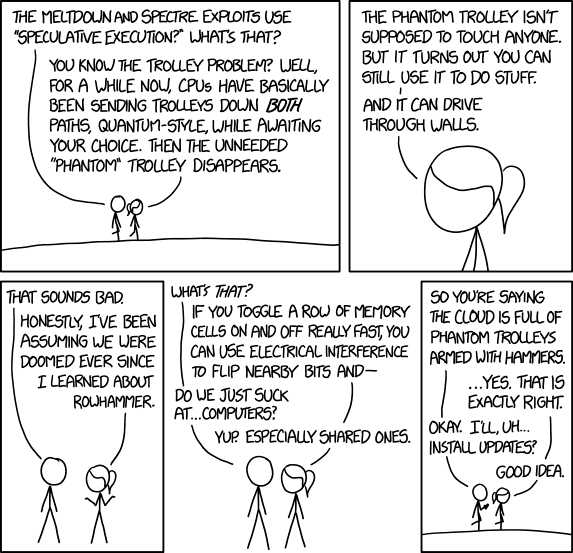

Apple zou telefoons en tablets van gebruikers willen scannen door foto’s op apparaten te vergelijken met beelden uit een kinderpornodatabase van het Amerikaanse National Center for Missing and Exploited Children. De software zou aanwezig zijn in iOS 15, het besturingssysteem voor iPhones dat in het najaar wordt uitgebracht.

De speciale software zou alarm slaan als hij denkt dat hij op illegale beelden is gestuit. Een team van onderzoekers bepaalt daarna of de autoriteiten worden ingeschakeld.

Apple zegt dat het proces op een privacyvriendelijke manier gebeurt. Een afbeelding zou door de technologie worden omgezet in een reeks letters, cijfers en symbolen en op die manier worden vergeleken met overeenkomstige codes in de database.

“Na feedback van klanten, belangengroepen, onderzoekers en anderen hebben we besloten de komende maanden extra tijd te nemen om meer informatie te verzamelen en verbeteringen door te voeren, voordat we deze uiterst belangrijke veiligheidsfuncties voor kinderen vrijgeven”, schrijft het bedrijf nu.

Experts en belangengroepen hebben veel kritiek op het systeem

Het is niet duidelijk wat Apple precies wil aanpassen. Ook is onbekend wanneer de technologie alsnog moet worden toegevoegd aan het besturingssysteem van iPhones en iPads.

Beveiligingsexperts en belangengroepen uitten de afgelopen weken veel kritiek op het systeem. Zo zou de technologie aangepast kunnen worden om andere soorten beelden op te sporen, zoals foto’s van antiregeringsprotesten of onthoofdingen door extremisten.

Critici vrezen dat andere techbedrijven straks onder druk gezet kunnen worden om gegevens op telefoons op een vergelijkbare manier in de gaten te gaan houden.