TikTok heeft in een Amerikaanse rechtszaak een nederlaag geleden die grote gevolgen kan hebben voor claims tegen andere socialemediabedrijven in de Verenigde Staten. Dat meldde Villamedia onlangs. De video-app kan zich niet op de bescherming voor tussenpersonen (Section 230) beroepen bij een claim wegens overlijden van een tienjarige die meedeed aan een “blackout-challenge”.

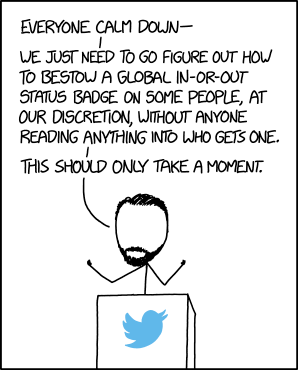

De moeder van het meisje had het platform aansprakelijk gesteld voor het overlijden, omdat het platform via algoritmes aanbevelingen deed voor filmpjes over deze challenge. De hoofdregel is natuurlijk dat platforms niet aansprakelijk zijn voor content van gebruiker. Section 230, de Amerikaanse DSA, bepaalt expliciet dat dit hen niet aangerekend kan worden.

Het argument hier was dat TikTok zich deze content eigen gemaakt heeft door (algoritmisch) deze te pushen. Dan ben je niet meer een doorgeefluik zeg maar. En dit gaat ook niet over moderatie: het is een keuze wat je aanbeveelt.

Het artikel zelf is beroemd en kort:

No provider or user of an interactive computer service shall be treated as the publisher or speaker of any information provided by another information content provider.

De term “publisher or speaker” moet breed opgevat worden. Het dekt alle gevallen waarin een platform content van anderen doorgeeft. Dus niet alleen de passieve kaders biedt waarin de video gestart kan worden, óók bij aanbevelingen, gesorteerde overzichten en zoekresultaten.

In een zaak uit 2023 (Gonzalez v. Google) bepaalde de US Supreme Court nog dat Google/Youtube niet aansprakelijk te stellen was voor medeplichtigheid aan de terreurorganisatie ISIS. Die had een Youtubekanaal met advertenties, wat Google (kennelijk oogluikend) liet bestaan ondanks vele klachten. De Supreme Court wees de claim af op Section 230: ongeacht hoe Google ook deze content had gepromoot of gesteund, dat maakte ze een “publisher or speaker” van informatie van een ander en dús niet aansprakelijk.

Het Hof van Beroep in deze zaak pakt er een recentere uitspraak bij (Moody v. Netchoice, 2024). Hierin verbood de Supreme Court de staten Florida en Texas om eigen regels te maken over wat platforms voor moderatiebeleid mogen stellen. Zulke eigen regels gaan in tegen het First Amendment: modereren en kiezen wat je wel en niet toelaat is jóuw beschermde expressie, in de zin van de uitingsvrijheid.

Het Hof van Beroep gebruikt dit als argument om te zeggen dat algoritmische aanbevelingen dus de eigen uitspraken zijn van TikTok, en geen content van een ander die zij doorgeeft. En omdat Section 230 alleen bij die laatste categorie beschermt, is TikTok dus aansprakelijk te stellen voor de eigen uitspraken, de algoritmische aanbevelingen die ze doet.

Probleem hiermee is alleen dat de opstellers van Section 230 expliciet met hun wet ook algoritmische aanbevelingen – zoekmachines, in 1995-terminologie – wilden beschermen. Het zou raar zijn dat je Google mocht aanspreken op een zoekresultaat met het argument dat het hún content is, en niet doorgegeven content van die site. Dan blijft er niets over van Section 230.

Dus nee, deze uitspraak van het Hof is fout. Alleen: dat moet naar het Supreme Court om rechtgezet te worden, en dat zal een paar jaar duren (zeker met de te verwachten stroom aan claims rondom de presidentsverkiezingen).

En natuurlijk, het voelt raar dat TikTok niets te verwijten valt bij het promoten van zulke ernstige (en strafbare) video’s. Maar dat los je niet op met een groot gat in een algemene regeling. De Europese aanpak met, naast zo’n algemene regeling, een specifieke plicht tot optreden tegen strafbare content (met adequate teams van moderatoren) en het stipt opvolgen van bevelen van autoriteiten is dan een stuk verstandiger.

Arnoud