Drie advocaten hebben tot nu toe een waarschuwing gekregen omdat zij verkeerd gebruik hebben gemaakt van kunstmatige intelligentie zoals ChatGPT. Dat meldde de NOS zondag. “”Wat AI produceert, leest vaak heel logisch. Ook als het eigenlijk onzin is” zo citeert men de Orde van Advocaten, iets waar ik me volmondig bij aansluit.

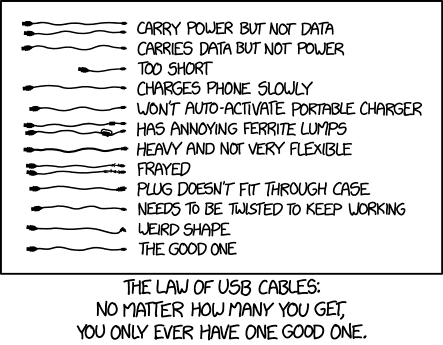

Het probleem is bekend: steeds meer juristen grijpen naar grote taalmodellen zoals ChatGPT, Claude of Perplexity en gaan er van uit dat hun uitvoer klopt. Alleen zitten er met hetzelfde gemak fictieve ECLI’s tussen, of wel-bestaande zaken die alleen over iets anders gaan. Wel jammer, want het klonk zeer overtuigend én bevestigde het gelijk van de cliënt.

Achteraf is het natuurlijk makkelijk kritiek leveren: dat had je moeten checken. Maar, zoals ik in mijn recente publicatie in juridisch vakblad NJB laat zien, dat is niet zo eenvoudig als het klinkt.

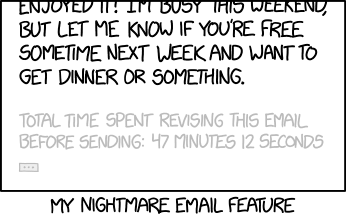

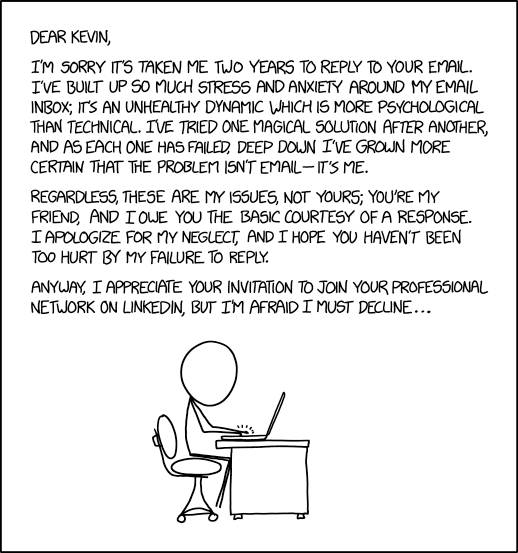

Generatieve AI-tools produceren vloeiende, coherente en zelfverzekerde teksten die de taal en vorm van juridisch gezag imiteren en uitnodigen tot direct hergebruik. Deze schijn van deskundigheid wordt versterkt door de ‘automatiseringsbias’: de menselijke neiging om een computer sneller te geloven dan een mens, zeker wanneer de uitleg vlot geformuleerd is. Daar komt een geraffineerde vorm van vleierij bij: AI-modellen optimaliseren hun antwoorden vaak op de gebruiker, die de uitvoer vervolgens ziet als een objectieve bevestiging van zijn eigen gelijk.

Oftewel, het klinkt zeer overtuigend binnen de context waarin je opereert, en appeleert aan alle signalen die je normaal gebruikt om een deskundig jurist te herkennen. Het is dan buitengewoon makkelijk om mee te gaan in diens betoog.

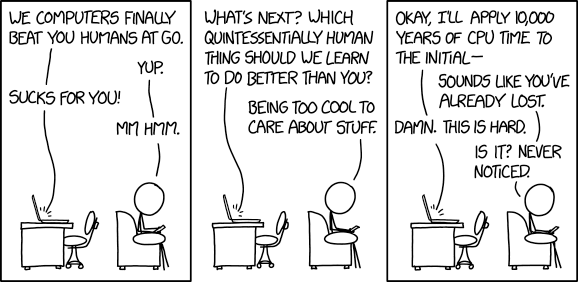

Hiermee om leren gaan vereist meer dan vanaf de zijlijn “haha je moet je bronnen ook checken” gaan roepen. Zeker omdat iedereen om je heen roept dat juridische AI het gaat worden, dat ChatGPT beter is dan menig collega en cliënten vragen waarom het vier uur kostte terwijl Gemini ook een mooie tekst maakt in 3 minuten. AI geletterheid is een ding, zeg maar.

(Terzijde: ik vind het echt onverantwoord om uitvoer van de publieke AI-tools te gebruiken in discussies over juridische AI. Kijk hoe goed deze ChatGPT-dagvaarding is, wat knap dat Gemini nu een foutloze pleitnota kan opstellen of een sommatiebrief kan beantwoorden. Je had mazzel dat de tekst geen al te obvious fouten bevatte, meer niet.)

Toch is het goed dat de Orde zo zichtbaar optreedt. Het dwingt kantoren tot processen implementeren om verantwoord AI-teksten tot juridische producten te maken. En dat is uiteindelijk wat we nodig hebben.

Tot sancties bij de rechter heeft het in Nederland nog niet geleid. Dat kan ook eigenlijk niet; boetes wegens contempt of court zijn bij ons niet mogelijk. In een paar zaken is artikel 21 Wetboek van Burgerlijke Rechtsvordering erbij gehaald:

Partijen zijn verplicht de voor de beslissing van belang zijnde feiten volledig en naar waarheid aan te voeren. Wordt deze verplichting niet nageleefd, dan kan de rechter daaruit de gevolgtrekking maken die hij geraden acht.

Indienen van een hallucinant stuk AI-tekst kun je zien als schending van deze verplichting. Alleen, wat moet de rechter doen in zo’n geval? Je kunt er voor kiezen dat document opzij te leggen, maar zoals de rechtbank Rotterdam daarover opmerkt:

De kantonrechter is voorshands van oordeel dat met de onjuiste verwijzingen weliswaar artikel 21 Rv is geschonden, maar dat het passeren van alle verweren uit de conclusie van antwoord een te zware sanctie voor [gedaagde 1] zou zijn.

Uiteindelijk raak je met zo’n actie vooral de cliënt. Het optreden van de Orde is dan ook eigenlijk de enige juiste route. Of je volgt onze cursus voor advocaten.

Oh ja, en voor wie zich afvraagt wat je dan wél met ChatGPT en collega’s kunt doen als jurist: ChatGPT is geen bron maar een methodologie, en daarmee basta.

Arnoud