Het is verboden om zonder toestemming naaktfoto’s te maken met AI-apps, maar het is doodsimpel om het tóch te doen. Dat meldde Nu.nl onlangs. De aanleiding is de recente waarschuwing van Meta over ‘nudify’-apps, beeldbewerking die een naakt lijf verzint binnen de contouren van degene die jij fotografeert. Oké dan.

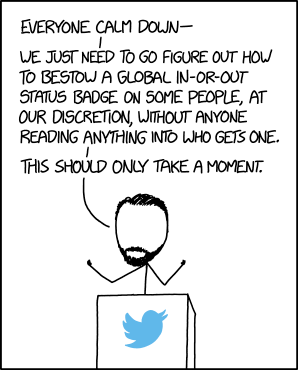

Meta heeft een rechtszaak aangespannen tegen de maker van CrushAI, een populaire app in dit genre, om te zorgen dat die niet meer adverteert op de Meta-platforms zoals Instagram. Dit op grond van de gebruiksvoorwaarden. Maar de app zelf blijft dus te vinden.

“Jijzelf weet dat de beelden nep zijn, maar je omgeving en anderen die de beelden zien weten dat niet”, zo citeert Nu.nl een woordvoerder van Slachtofferhulp. Daarmee worden mensen alsnog kwetsbaar voor chantage en andere onfrisse praktijken. Er moet dus wat gebeuren, en de organisatie stelt een apart verbod voor.

Een verbod staat of valt met handhaving, maar heeft hier ook een signaalwaarde. Als je op scholen en andere plekken waar dit speelt kunt zeggen “zo’n app hebben is verboden”, dan kun je jongeren en hun ouders (hopelijk) via een moreel appèl aanspreken. En wie deze toch gebruikt, kun je dan via schoolregels aanpakken – net zoals bij jongeren die messen naar school brengen, bijvoorbeeld.

Als het slachtoffer nog geen 18 is, dan is het gebruik van zo’n app strafbaar als het vervaardigen van kindermisbruikmateriaal (art. 252 Strafrecht). Maar ook als het gaat om een volwassene is het strafbaar als het vervaardigen “opzettelijk en wederrechtelijk” gebeurt (art. 254ba). Bij zo’n app is daar zonder twijfel sprake van.

Het punt is vooral: er is geen strafbaarheid op bezit of verspreiden van de app. Dat was nooit echt relevant: dergelijk beeld maakten mensen met camera’s of andere algemene middelen, dus je komt er niet uit hoe je “stiekeme camera voor strafbaar beeld” onderscheidt van “camera”. Dit is ook waarom stiekem fotograferen (art. 139f) strafbaar is maar stiekemfotograferencamera’s niet.

Zou het kunnen? We hebben het voorbeeld van de hackhulpmiddelen (art. 139d), een “technisch hulpmiddel dat hoofdzakelijk geschikt gemaakt of ontworpen is tot”. Zet erachter “het maken van beelden bedoeld in 254ba of 252” en je bent er. Gewone camera’s zijn niet specifiek geschikt voor dergelijk beeld, deze naaktapps wel.

Net als bij hackmiddelen krijg je dan gelijk discussie over waar de grens ligt. Software kan zowel voor een legitiem securityonderzoek geschikt zijn als voor illegaal werk, soms hangt dat alleen af van het hebben van een pentestopdrachtovereenkomst. Het wettelijk criterium moet je dan van geval tot geval oplossen.

Hier is het probleem dat deze apps (meestal) niet letterlijk zeggen “upload een foto van eender wie en wij plakken er een naakt lijf onder”. De verpakking zijn “AI girlfriend” apps (want het gaat altijd over vrouwen) die je dan in staat stellen afbeeldingen samen te stellen met allerlei parameters. En ergens verstopt zit dan “upload sample image”.

Anderen presenteren zich explicieter maar presenteren zich dan als neutrale tool: jij kiest de foto, maar jij verklaart dan tevens dat alles helemaal juridisch in orde is. En daar is het dan op papier misschien nog wel makkelijk tegen optreden, maar het bedrijf zit dan in Hong Kong en kan zo weer verder vanuit een nieuwe Ltd.

Arnoud