Facebook heeft ruim tweehonderd organisaties verwijderd die gelinkt zijn aan white supremacy, een ideologie waarbij geloofd wordt dat mensen met een lichte huidskleur superieur zijn. Het blokkeren van de groepen is onderdeel van een aangepast beleid van Facebook tegen terrorisme en haat.

Voorheen focuste Facebook bij de bestrijding van terrorisme op grote organisaties als IS en Al Qaeda, maar nu richt Facebook de aandacht ook op individuen en kleinere haatdragende groepen en organisaties. Daardoor zijn nu ruim tweehonderd white supremacy-groepen verwijderd.

Facebook zet een combinatie in van kunstmatige intelligentie en medewerkers die de content beoordelen. Naast groepen, verwijdert Facebook ook berichten waarin bewondering of ondersteuning voor de groepen wordt uitgesproken.

Eerder dit jaar maakte Facebook ook al bekend berichten die refereren aan white nationalism en white separatism te gaan verwijderen.

Veranderd beleid na aanslag Christchurch

Facebook scherpt het beleid gericht op de bestrijding van terroristische inhoud aan na de aanslag op Christchurch, waar de dader de terreurdaad livestreamde op Facebook.

In het blog laat Facebook weten dat “de daad het misbruik van technologie om radicaal gedachtegoed te verspreiden toonde en liet zien dat de herkenning van en actie tegen gewelddadige extremistische inhoud moet verbeteren”.

Ook laat Facebook weten de definitie van terroristische organisaties aangepast te hebben. Tot nu toe hanteerde Facebook een definitie waarbij werd gefocust op geweld met een politiek of ideologisch motief. Daar wordt geweld gericht op burgers met het doel te intimideren aan toegevoegd.

Samenwerking met leger om beelden beter te herkennen

Facebook kreeg na de aanslag in Christchurch kritiek te verduren op de verspreiding van beelden van de aanslag op het sociale netwerk. Daarop stelde Facebook beperkingen in op wie mag livestreamen. Maar het bedrijf gaat nu ook samenwerken met de Amerikaanse en Britse overheid om dergelijke beelden voortaan sneller te herkennen.

Vóór de aanslag waren de algoritmes die gewelddadige inhoud moeten herkennen niet getraind op beelden vanuit de eerste persoon, zogenoemde first person shootings. Facebook wil nu first person-beelden van trainingssessies van het leger inzetten om de software te trainen, zodat in de toekomst first person-beelden van echte gebeurtenissen worden herkend, zonder dat dergelijke beelden uit films en games worden geblokkeerd.

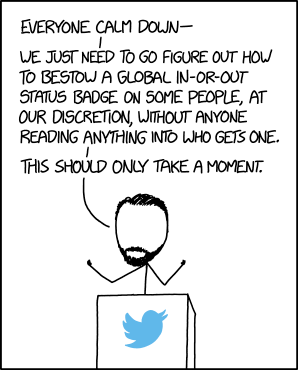

Facebook komt met de update van de richtlijnen vlak voordat het bedrijf op woensdag 18 september voor de Amerikaanse Senaat moet verschijnen samen met Google en Twitter, in verband met zorgen over de rol van sociale media in massaschietpartijen.