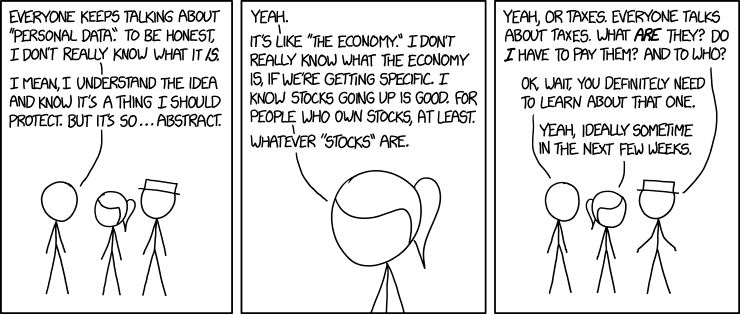

Apple wil hetzelfde doen, maar dan lokaal. Op je iPhone draait binnenkort een programmaatje dat jouw fotobibliotheek vergelijkt met de ‘kinderpornolijst’. Wordt een bepaalde hoeveelheid foto’s of video’s aangemerkt als kinderporno, dan worden ze gedeeld met Apple, die ze daarop weer deelt met de autoriteiten.

Dat gebeurt alleen als je het back-uppen van je foto’s naar iCloud hebt ingeschakeld; als dat niet zo is, worden je foto’s niet gecontroleerd.

Principiële stap

Hoewel de feitelijke werking dus niet veel anders is dan bij andere clouddiensten, gaat het om een belangrijke principiële stap, zeggen critici. Voor het eerst draait er op je telefoon software die in de gaten houdt wat voor foto’s en video’s je opslaat.

Hoewel Apple het systeem uitsluitend voor kinderporno belooft te gebruiken, zijn er risico’s. “Het is een lastige discussie, want niemand is tegen het bestrijden van kinderporno”, zegt jurist Terstegge. “Maar het gevaar is dat dit mechanisme ook voor andere doeleinden wordt ingezet.”

Zo zou een overheid, bijvoorbeeld die van China, Apple in theorie kunnen vragen om ‘onwelgevallige’ foto’s en video’s te verbieden. Hoewel er geen aanleiding is om te denken dat Apple daaraan zou willen meewerken, is dat iets wat op dit moment technisch onmogelijk is, maar binnenkort wel.

Balans

Arda Gerkens, directeur van het expertisebureau Online Kindermisbruik en daarnaast ondervoorzitter van de Eerste Kame,r is juist wél te spreken over het systeem,

“Het lijkt erop dat Apple heeft gezocht naar een balans tussen privacy en het beschermen van kinderen”, zegt Gerkens. “Voor zover we kunnen zien is dat gelukt.”

Want het lokaal controleren van foto’s en video’s heeft ook een privacy-voordeel: het gebeurt volledig zonder dat Apple er weet van heeft en je foto’s verwerkt. Het is een principe dat Apple ook toepast bij gezichts- en objectherkenning op foto’s. Waar Google dat doet op zijn computers in datacenters, doen iPhones dat lokaal.